|

|

|

|

Andrzej

Zimniak

Kilka uwag o upowszechnianiu nauki

"Upowszechnianie nauki" to termin niezwykle

szeroki, a więc nieostry znaczeniowo i, co za tym idzie, mało precyzyjny. Chwila

zastanowienia nad tym pojęciem owocuje szeregiem natychmiastowych wątpliwości i

pytań. A więc, po pierwsze: czy przez upowszechnianie należy rozumieć tylko

działalność, mającą na celu przekazywanie wiedzy do szerokich rzesz

społeczeństwa, czyli po prostu popularyzację, czy może także publikowanie prac

sensu stricte naukowych przez badaczy przyrody, techniki i zjawisk

społecznych? A może, uogólniając pojęcie jeszcze bardziej, także wdrażanie

naukowych osiągnięć do praktyki technologicznej?

Rozważając powyższe, a także dalej postawione

kwestie będę starał się analizować je zgodnie ze swoją wiedzą i przekonaniami,

co oczywiście nie znaczy, że wnioski zadowolą każdego, a nawet że wszystkim

wydadzą się słuszne. Gdyby jednak artykuł stał się przyczynkiem do dyskusji na

tematy, związane z niezwykle istotnym zagadnieniem upowszechniania wiedzy i

nauki w Polsce w okresie przemiany ustrojowej, otwarcia kraju na świat i

ogólnocywilizacyjnych tendencji globalizacyjnych, cel tej publikacji będę uważał

za spełniony.

Na wstępie należy przjrzeć się dotychczas

formułowanym definicjom (zwięzły przegląd: Edward Hałoń, Nauka 2/97, 185).

Wielce zasłużony dla upowszechniania nauki prof. Bogdan Suchodolski ustalił w

1962 roku termin "upowszechniania nauki, które przekazuje informacje o jej

metodach i osiągnięciach ludziom pracującym i czyni to w sposób zupełnie ścisły"

(Nauka Polska 1/62). Autor ten rozróżnia także między dziełem naukowym, a

upowszechniającym naukę lub, inaczej, popularnonaukowym. Nieco inna jest nowsza

definicja prof. Gerarda Labudy (Nauka Polska 1-2/86), który pisze: "Kumulatywne

określenie >>upowszechnianie nauki<< zawiera w sobie w gruncie rzeczy aż trzy

kierunki działań, a więc: 1. upowszechnianie nauki w ścisłym tego słowa

znaczeniu, to jest innowacji będących w stadium stawania; 2. upowszechnianie

wiedzy, wyrastające z twierdzeń i uogólnień, uznanych przez naukę za aktualny

stan jej poglądu; 3. upowszechnianie techniki i technologii. Z kolei prof. Haman

(Nauka 2/97, 177) opisowo tłumaczy anglosaski zwrot science communication

jako "ciągle rozszerzającą się działalność stymulowana potrzebą lepszego

wzajemnego zrozumienia pomiędzy ludźmi nauki i osobami nie zajmującymi się

zawodowo nauką, lub ogólniej, społecznością".

Sens określenia "upowszechnianie", zgodny z

etymologią tego słowa, oznacza działanie, skierowane do szerokiego forum

odbiorców, nie będących specjalistami - więc jednak mogą to być ludzie nauki,

lecz z innych specjalności. Przychylę się do definicji B. Suchodolskiego, który

nie rozszerzał nadmiernie zakresu znaczeniowego omawianego pojęcia (podobna jest

definicja J. Hamana). Nie sądzę również, aby używanie określenia "popularyzacja

nauki" było deprecjonujące czy merytorycznie zawężające. Przecież zasadniczo o

to chodzi w tak rozumianym upowszechnianiu nauki, aby niespecjalistom dostarczyć

podsumowującej informacji naukowej w zrozumiały dla nich sposób, a także

umożliwić pogłębianie wiedzy w kierunkach wybranych przez samych

zainteresowanych. Określenie "upowszechnianie wiedzy" jest nieco szersze, bo

może dotyczyć także informacji niekoniecznie przez naukę weryfikowalnych, lecz

będzie w zasadzie tożsame, jeśli weźmiemy pod uwagę "wiedzę naukową".

Zgodnie z powyższym nie sądzę, aby publikowanie

artykułów ściśle naukowych, a więc opisywanie i udostępnianie wyników aktualnie

prowadzonych badań, należało zaliczyć do upowszechniania nauki. Tego rodzaju

działalność, będącą oczywistym etapem końcowym każdej pracy naukowej, nazwałbym

raczej wymianą informacji w środowisku badaczy. Od kiedy istnieje nauka,

pojmowana w dzisiejszy lub chociaż zbliżony do dzisiejszego sposób, ma miejsce

publikowanie wyników, a prace te, ze względu na swoją złożoność, specyfikę i

wąską z reguły specjalizację, adresowane są zwykle do innych ludzi nauki, i to

przeważnie z tej samej dziedziny, w której badania prowadzi autor pracy. Dopiero

później te specjalistyczne artykuły zostają przetworzone, popularyzatorzy

streszczają je (oczywiście jeśli są tego warte!), spłaszczając i kondensując ich

treści, upraszczają je i w ten sposób dostosowują do powszechnego odbioru, ale

to już zupełnie inna sprawa. Rzecz w tym, aby cyrkulowania specjalistycznej

informacji, stanowiącego integralny i absolutnie konieczny etap każdej pracy

badawczej w środowisku, reprezentującym otwarty model nauki, nie mylić z

upowszechnianiem wiedzy. Upowszechnianie wiedzy, przynajmniej w prezentowanym

przeze mnie rozumieniu, jest elementem kształcenia społeczeństwa, czyli

działaniem planowym, częścią koncepcji rozwoju państwa czy regionu, aktywnością

o mniejszym lub większym nasileniu, wręcz wynikiem decyzji politycznej, która

może, ale nie musi zapaść. Bez stałego przepływu informacji nie ma nauki,

natomiast bez upowszechniania nauki społeczeństwa mogą istnieć, ba, mogą nawet,

w sprzyjających warunkach i ograniczonych okresach, zupełnie dobrze prosperować.

Wdrażania przemysłowego wynalazków i innych

naukowych osiągnięć również nie zaliczam do upowszechniania nauki, biorąc pod

uwagę przytoczone ograniczenia definicyjne, aczkolwiek końcowym efektem tego

procesu jest praktyczne i szerokie zastosowanie produktu myśli naukowej. Pomimo

tego należy rozróżniać pojęcia "upowszechnianie" i "zastosowanie". To pierwsze

dotyczy, w pewnym uproszczeniu, zwielokrotnienia i rozprowadzenia pośród

obywateli zarówno idei, koncepcji, jak i, w uogólnieniu, przedmiotów w

określonej postaci czy kształcie, zaproponowanym przez upowszechniającego. A

więc są to przedsięwzięcia, podejmowane przez organizacje upowszechniające

wiedzę lub przez popularyzatorów, a ich adresatem jest społeczeństwo, przy czym

ów adresat zazwyczaj pozostaje stosunkowo biernym podmiotem. Zgoła odmienny jest

mechanizm wdrożeń technologicznych, przy których przedstawiciele przemysłu w

selektywny sposób czerpią to, co jest im potrzebne, ze skarbnicy osiągnięć

nauki. Ze względu na ścisłą specjalizację i specyfikę, a także zróżnicowane

profile produkcyjne, inicjatywa musi przyjść od producentów, a właściwie od

laboratoriów przemysłowych. Sami wytwórcy najlepiej wiedzą, co jest im potrzebne

do bieżącej innowacji procesów, a jaką koncepcję warto kupić w celu stworzenia

zupełnie nowej technologii. Owszem, naukowcy obeznani z technologią mogą (i

powinni) występować z inicjatywami specjalistycznymi i ukierunkowanymi, lecz

inicjatywy te siłą rzeczy pozostaną działaniem indywidualnym i raczej

sporadycznym, a jeszcze rzadziej zwieńczy je sukces. Natomiast akcje szerokiego

upowszechniania wszelkiej myśli naukowej, która przedstawicielom instytucji

upowszechniających wydaje się "podatna technologicznie", nie spełnią swojego

zadania i zawsze pozostaną działaniami w dużym stopniu fasadowymi.

Zupełnie odmienną sprawą, godną silnego poparcia,

jest ułatwianie przepływu informacji, np. przez wsparcie dla krajowych czasopism

naukowych o profilu technologicznym lub wydawanie takich czasopism. Jednakże

działania takie, według przytoczonej wyżej definicji, nie stanowią typowego

upowszechniania nauki, ponieważ czasopiśmiennictwo naukowe integralnie należy do

zjawiska zwanego współczesną nauką i musi w jej granicach funkcjonować,

niezależnie od różnego rodzaju przedsięwzięć upowszechniających i

popularyzujących. Z drugiej strony nowoczesny, prężny przemysł nie potrzebuje

zachęty, jego przedstawiciele i tak wertują najnowsze publikacje naukowe, bo

tego wymaga zachowanie konkurencyjności na rynku. Inna rzecz, że Polska wciąż

znajduje się w stadium transformacji, reformy nie są dokończone, a więc sytuacja

jest szczególna. Jednakże, zamiast trochę na siłę forsować wdrożenia i

innowacyjność, może lepszą drogą byłoby dokończenie reform i wyzwolenie rezerw

innowacyjnej inicjatywy w zakładach przemysłowych?

Powróćmy do wątku głównego, czyli upowszechniania

nauki, rozumianego jako "niesienie kagańca" wiedzy do statystycznego obywatela.

Zanim ów trud się podejmie, trzeba upewnić się, że działanie jest sensowne, a

więc należy rozważyć pytanie, czy w ogóle warto upowszechniać naukę, i czy ów

strategiczny cel polityczno - społeczny godny jest wielkiego przecież wysiłku i

niemałych nakładów? Czy nasz statystyczny obywatel życzy sobie takiego

działania, adresowanego bezpośrednio do niego, czy zechce przeznaczyć na odbiór

skierowanego do niego przekazu swój czas, i czy będzie się to jemu opłacało?

Patrząc od drugiej strony, czy nowoczesny organizm państwowy zainteresowany jest

w dokształcaniu obywateli i czy kasę państwową stać na tego rodzaju długofalową

inwestycję? Jeśli te pytania potraktować trywialnie jako slogany, można

odpowiedzieć również sloganami, że oczywiście, "nauka do potęgi klucz". Ale z

wymiany sloganów niewiele wynika, zwłaszcza w zakresie analizy i tworzenia

koncepcji. Być może gloryfikacja nauki i jej dorobku jest efektem

bezwładnościowym po okresie naukowego elephantiasis - wszak obliczono, że

gdyby wzrostowy trend w tej dziedzinie ludzkiej działalności, notowany po

półmetku XX wieku, utrzymał się dłużej, to niebawem cała ludność Ziemi

składałaby się z naukowców (lecz, naturalnie, nie z uczonych!). Oczywiście jest

to redukcja do absurdu metodą liniowej ekstrapolacji, ale nawet w tego rodzaju

matematycznych żartach jest ziarnko prawdy.

Od dłuższego czasu widoczny jest wyraźna

tendencja: rozwinięte gospodarczo państwa zmniejszają wydatki na naukę. Jeszcze

30 lat temu w USA na ten cel były przeznaczane spore środki, potem badawczy

budżet stopniowo zmniejszano. Dziś otrzymanie grantu badawczego z NIH czy NSF

jest niesłychanie trudne, co rodzi wiele frustracji w tamtejszym środowisku

naukowym. Podobnie jest w innych krajach; u nas wydatki na badania zmniejszono w

roku 1998 do 0,47% PKB. Można powiedzieć, że jeśli chodzi o tempo tych redukcji,

jesteśmy w ścisłej światowej czołówce. Nie czas i miejsce, aby te zjawiska

komentować, lecz bez wątpienia stanowią one znaczący symptom globalnych zmian

cywilizacyjnych. Lecz jak w kontekście tych procesów odnieść się do

upowszechniania nauki?

W miarę rozwoju nauki, który w wielu "gorących

punktach" jest naprawdę błyskawiczny (każdy tydzień przynosi istotne nowości),

zwiększa się rozziew między społeczną świadomością, dotyczącą tej wiedzy wraz z

jej praktycznymi aplikacjami, a naukowym "frontem", który przemieszcza się

często w obszarach całkowicie abstrakcyjnych nie tylko dla zwykłego zjadacza

chleba, ale także dla osób z wyższym wykształceniem. Przez ostatnie

dziesięciolecia zgromadzono tak wielką wiedzę o świecie, że upowszechnienie i

praktyczne zastosowanie nawet tylko tej jej części, która jest naprawdę istotna,

w naszym ogólnie słabo wyedukowanym społeczeństwie zajęłoby następne

dziesięciolecia, i to bez względu na tempo przesuwania się "frontu naukowego".

Nie warto więc, rozważając kwestię upowszechniania wiedzy w Polsce, oglądać się

na światowe tendencje chłodzenia przegrzanej naukowej koniunktury. My mamy wciąż

olbrzymie braki do nadrobienia, zresztą nie tylko my. Skarbnica wiedzy jest

zasobna, można czerpać do woli i przekazywać bliźnim. W tym miejscu powraca

pytanie zasadnicze: czy warto? Co i komu z tego przyjdzie?

Jedną z powszechnie znanych doktryn rządzenia jest

utrzymywanie społeczeństwa na niskim poziomie edukacji, ponieważ taką "szarą

masą" łatwiej kierować. Nie ma wtedy wysublimowanych żądań intelektualnych,

wystarczy grać na niskich, podstawowych popędach i odruchach, a w zamian za

pracę dawać "chleb i igrzyska". Kiedyś taki model sprawowania władzy mógł

rzeczywiście dobrze się sprawdzać, zwłaszcza w państwach zasobnych w ludność i

bogactwa naturalne. Dziś już nie wystarcza, i to z paru powodów.

Kluczową przyczyną konieczności otwarcia na wiedzę

jest fakt, że cywilizacyjna technologia wkroczyła na niemal każde stanowisko

pracy. Czysta praca fizyczna w coraz mniejszym stopniu jest udziałem ludzi,

natomiast ludzie w coraz większym stopniu zmuszeni są do współpracy z maszynami.

Te maszyny nie tylko nastręczają trudności w sterowaniu ze względu na stopień

swojego skomplikowania, ale także oferują tak szerokie spektrum możliwości

działania i wyboru, że niezbędny jest wysoki stopień intelektualnego

zaangażowania ze strony obsługującego je człowieka. Klawiatura komputera ma

około stu przycisków, ale przecież nie wystarczy znać ich funkcje, żeby

efektywnie wykorzystywać tę maszynę do pracy. Nadinformacyjność cywilizacyjna

stawia ludzi przed ciągłymi wyborami, a dokonanie właściwego wyboru wymaga

odpowiedniego zasobu wiedzy. Aby np. dotrzeć do potrzebnych danych, nie

wystarczy znać sposób, bo ten, który był znany wczoraj, dziś może być

nieaktualny, lecz należy, na drodze logicznego rozumowania, określić nową, już

dostępną drogę. A do tego znów potrzebna jest wiedza, także ta o efektywnych

sposobach rozumowania. Reasumując, jeśli chcemy jako naród uczestniczyć w

światowym procesie globalizacji kultury i technologii, każdy Jan Kowalski i

każda Maria Majewska muszą wiedzieć, z czego ten świat się składa, jak

funkcjonuje i jak się w nim poruszać.

No dobrze, odpowie ktoś, ale są państwa, nawet

mocarstwa, w których średni poziom edukacji jest niższy niż u nas. Na przykład w

USA przysłowiowy "czerwony kołnierzyk" (w tamtejszym slangu: farmer z opalonym

karkiem) czasami je puszkowane mięso dla psów, bo nie umie czytać, a o tym,

gdzie leży Warszawa, nie ma nawet bladego pojęcia (niektórzy tamtejsi ludzie po

studiach, których o to pytałem, przypuszczali, że... może gdzieś w Rosji).

Pomimo tego nasycenie najnowszą technologią jest w tym kraju większe niż w

Europie Zachodniej, a nauka stoi najwyżej w skali światowej. Wynika stąd, że

wiedza praktyczna, potrzebna do funkcjonowania w nowoczesnym społeczeństwie,

jest u Johna wystarczająca; być może, że jest ona selektywna i ograniczona, ale

pragmatyczne kryterium efektywności ma decydujące znaczenie. Nasz Jan musi się

więc trochę poduczyć, a także przeprofilować swoją dzisiejszą wiedzę, aby lepiej

przystawała do współczesnego świata; edukacja szkolna bezwzględnie powinna mieć

w tym procesie swój istotny udział. Wracając zaś do porównań, to nasze

przymiarki do światowego mocarstwa nie mają wielkiego sensu, ponieważ skala

zjawisk jest diametralnie inna, np. 1% PKB oznacza zupełnie co innego u nich i u

nas. Nie można również pominąć aspektu położenia geopolitycznego: odmienne

uwarunkowania, inna perspektywa narodowego bytu.

Dochodzimy do podstawowego pytania: o cele

strategiczne. Każdy odpowiedzialny polityk próbuje zrobić coś w tym kierunku,

przynajmniej w pierwszej połowie swojej kadencji. Jaką perspektywę ma przed sobą

społeczeństwo o niskim poziomie wykształcenia, nie potrafiące w pełni

wykorzystać współczesnych możliwości cywilizacyjnych? Zwłaszcza jeśli składa się

ono ze stosunkowo niewielkiego narodu, otoczonego przez szybko rosnących

sąsiadów.

Taki naród, jeśli jest wystarczająco liczny i

jeśli jego zapóźnienie rozwojowe nie jest zbyt wielkie, może stać się

doskonałym, chłonnym rynkiem zbytu dla lepiej gospodarczo rozwiniętych państw o

innowacyjnej gospodarce. Może też, w pewnym stopniu, pełnić rolę gospodarczego

zaplecza, na którym dokonywane są inwestycje ze względu na tanią siłę roboczą -

pracowników można tam bez trudu werbować w grupach silnie motywowanych

aspiracjami materialnymi. Państwo, zamieszkiwane przez taki naród, ma coraz

mniejszy wkład w rozwój cywilizacji, odsuwa się na coraz dalsze peryferie, staje

się słabym gospodarczo konsumentem i traci stopniowo na znaczeniu. Wiemy dobrze,

że w dostatecznie odległym horyzoncie czasowym samodzielny i suwerenny byt

takiego państwa może być zagrożony.

Z powyższego wynika, że odpowiedni poziom

społecznej wiedzy konieczny jest zarówno do bieżącego funkcjonowania

współczesnego państwa, jak i do realizacji strategii narodowego bytu. Nie waham

się nawiązać w tym miejscu do pozytywistycznej koncepcji "pracy od podstaw",

która, nawet w tak odmiennych uwarunkowaniach historycznych, jakie obecnie

istnieją, niewiele straciła na znaczeniu od czasów Wokulskiego. W tym kontekście

pojawia się interesujące pytanie o kulturotwórczą rolę powszechnej edukacji,

lecz temat ten wykracza daleko poza ramy niniejszego artykułu.

Mówiąc o upowszechnianiu wiedzy i nauki trzeba

wskazać na kształcenie szkolne jako podstawę, do której korzeniami sięgają

wszystkie inne formy edukacji. Dla olbrzymiej większości populacji kontakt z

nauką zaczyna się i kończy w szkolnej ławce, a więc należy zadbać o to, aby

przyniósł on należyte rezultaty. Ponadto efekt wszelkich wysiłków, mających na

celu upowszechnianie nauki w społeczności ludzi dorosłych, okaże się w dużym

stopniu chybiony, jeśli adresaci upowszechniania nie posiądą przedtem

odpowiedniego minimum wiedzy i należytych umiejętności. Ziarno najplenniejszej

rośliny nie wykiełkuje na litej skale, a skała ignorancji bywa w kwiecie wieku

naprawdę trudna do skruszenia.

Daleki jestem od zamiaru analizowania rozlicznych

i niesłychanie odpowiedzialnych funkcji szkoły, pragnę tylko zaakcentować, czego

od szkoły oczekujemy w kontekście poruszanych tu problemów. Przede wszystkim

wykreowania w młodych umysłach całościowej wizji świata, w której jest miejsce

zarówno na kosmologię, jak i na mikrobiologię i genetykę, na przekrojową

historię ludzkości i ojczystego kraju, jak i na przegląd mitów i odwiecznych

marzeń człowieka. Taka wizja nie może zanadto obrastać w szczegóły, bo jako

całość traci na wyrazistości lub wręcz ulega deformacjom. Po drugie, nauka

szkolna powinna położyć szczególny nacisk na przygotowanie adeptów do

indywidualnego odnalezienia się i skutecznego działania we współczesnym świecie,

czyli nastawić się na kształtowanie postaw praktycznych, pragmatycznych i

racjonalnych, aktywnych i poszukujących. Dopiero tak przygotowanemu człowiekowi,

wykształconemu uniwersalnie, choć niekoniecznie drobiazgowo, można w ramach

upowszechniania nauki skutecznie przekazywać wiedzę na temat najnowszych odkryć

i cywilizacyjnych dylematów etyczno-moralnych, umożliwiać kształcenie

permanentne, a także proponować współdecydowanie o kierunkach dalszego rozwoju

nauki i technologii. Dla innych, których wiedza nie osiągnęła swoistej "masy

krytycznej", publikacje upowszechniające osiągnięcia naukowe pozostaną

jednorazowymi, częściowo tylko zrozumiałymi sensacyjkami, a na samoedukację ci

ludzie okażą się całkowicie zaimpregnowani, ponieważ nawet nie będą w stanie

zrozumieć słownictwa popularnonaukowych artykułów.

Każde społeczne działanie ma swojego adresata.

Podmiotem wysiłków upowszechniających wiedzę naukową i bohaterem tego artykułu

jest Jan Kowalski, statystyczny obywatel RP, średnio wyedukowany i trochę (nie

za bardzo) ciekawy świata (ponieważ ci bardziej ciekawi dadzą sobie radę bez

naszych wysiłków). Można sobie jednak wyobrazić innych adresatów, np. decydentów

ze sfer rządowych lub parlamentarnych. Na tym etapie rozważań dochodzimy do

istotnego problemu podziału środków, czyli budżetowych wydatków na naukę. Na

popularności zyskuje pogląd, że upowszechniając naukę można doprowadzić do

zwiększenia tych wydatków. Teza ta wydaje mi się wątpliwa.

Każda partia polityczna w okresie przedwyborczym

szermuje szczytnymi hasłami, nie żałując tak zwanej "kiełbasy wyborczej". Po

przejęciu władzy działalność nowych elit rządzących ma programowo zmniejszyć

bezrobocie i jednocześnie w odczuwalny sposób zwiększyć dochody ludności, a

także poprawić stan bezpieczeństwa publicznego i opieki zdrowotnej. W następnej

linii obietnic znajduje się m.in. zwiększenie wydatków na naukę i edukację. Tak

jest na razie, dopóki "uprawianie nauki" jest obiegowym i chwytliwym hasłem

pozytywnym, na równi z ochroną środowiska naturalnego lub np. ochroną zwierząt

doświadczalnych przed stresem, bo w przyszłości, jak wyżej wspomniałem, wymowa

tego hasła może ulec odwróceniu. Stopień społecznej akceptacji dla nauki będzie

zależał od tego, z czym opinia publiczna skojarzy tę dziedzinę ludzkiej

działalności: czy np. z nowymi i skutecznymi lekami przeciw nowotworom, czy może

z transgenicznym monstrum i kastami zunifikowanych ludzkich klonów? Na razie

slogan o pozytywnej wymowie funkcjonuje bez zarzutu, choć aplikuje się go

społeczeństwu jedynie do dnia wyborów; potem budżet nauki staje się zazwyczaj

obiektem pierwszych cięć, a opinia publiczna ma zerowy wpływ na ten stan rzeczy,

wpływ zresztą całkowicie potencjalny, bo jej zainteresowanie sprawami

finansowania nauki jest równie małe. I trudno się dziwić, bo statystyczny

Kowalski ma zupełnie inne problemy. Tego, że wielkość państwowych wydatków na

naukę w żadnym stopniu nie jest zależna od średniego poziomu społecznego

wykształcenia, dowodzi spadek nakładów na badania przy jednoczesnej

intensyfikacji popularyzacji nauki w krajach zachodnich w latach 80-tych. Wydaje

się, że lobby naukowe popełnia błąd, planując zwiększyć swój budżet tą drogą.

Zupełnie innym adresatem są elity rządzące,

jednakże wahałbym się użyć terminu "upowszechnianie" czy "popularyzacja" w

odniesieniu do zabiegów, mających na celu przekazanie tym grupom społecznym

informacji o nauce, jej potrzebach i osiągnięciach, a także prognoz rozwojowych.

Po pierwsze, elity niejako z założenia reprezentują najwyższy poziom

intelektualny, więc określenie "upowszechnianie", które nawiązuje do

powszechnych, czyli podstawowych procesów, jest trochę nie na miejscu, zwłaszcza

że do rządu i parlamentu wchodzi coraz więcej ludzi z najwyższymi naukowymi

tytułami. Lepszym określeniem jest "bieżące informowanie", choć nie jestem

przekonany do skuteczności, a nawet celowości przekazywania tego rodzaju

informacji. W przeciwieństwie do roli cyrkulacji informacji w środowisku

naukowym, którą można porównać do fundamentalnych funkcji krwiobiegu w

organizmach żywych, szczegółowe informowanie ministrów i posłów np. o

osiągnięciach na polu badania parametrów trących części maszyn i urządzeń, albo

expressis verbis o ogromnych potrzebach aparaturowych w zakresie badania

struktury molekularnej polimerów termoodpornych, często trąci czczą retoryką i

ma chyba niewielki sens, a zwłaszcza niewielki wpływ (oczywiście niczego nie

ujmując badaniom w wymienionych kierunkach). Decydenci związani z kręgami

rządowymi i sejmowymi z zasady, a także z konieczności, bazują w swoich ocenach

na specjalistycznych, zamawianych ekspertyzach, które są jednocześnie

wystarczająco przekrojowe i podbudowane konkretnymi danymi liczbowymi, aby można

było na ich podstawie uprawiać politykę. Chcę być dobrze zrozumiany: nie

twierdzę, że tego rodzaju naukowy lobbing i szczególnego rodzaju promocja nauki

nie mają żadnego sensu, sądzę wszakże, że efektów takiej działalności nie

powinno się przeceniać.

Wszystko wskazuje na to, że to nie ludzi ze sfer

rządowych powinno się poddawać procesom upowszechniającym naukę, lecz au

rebours, to rządowi powinno zależeć na jej upowszechnianiu w społeczeństwie.

Wskazywałem już na wymiar pragmatyczno-cywilizacyjny i narodowo-strategiczny

tego procesu. Nie od rzeczy będzie jeszcze wspomnieć o celach bliskich,

osiągalnych w ciągu niewielu lat: szybszym rozwoju gospodarczym, większej

innowacyjności i przedsiębiorczości, a także wydajności pracy i motywacji do jej

wykonywania w społeczeństwie na wyższym poziomie intelektualnym. Ponieważ poziom

ten ściśle wiąże się z rozumieniem dzisiejszego świata w kategoriach

współczesnej nauki, rząd powinien wspierać wszelkie procesy upowszechniania

wiedzy i nauki w oparciu o wymierne kryteria ekonomiczne.

Te kryteria ekonomiczne powinny działać w obie

strony, bo dziś nie ma nic za darmo (zresztą nigdy nie było, tylko kiedyś nie

mówiło się, kto płaci, lecz kto korzysta). Jak jednak tego dokonać, żeby Jan

Kowalski, podmiot działań upowszechniających wiedzę i naukę, nie tylko zechciał

brać udział w procesie, ale jeszcze wyłożył pieniądze z własnej kieszeni?

Realizacja takiego przedsięwzięcia wydaje się tak trudna, że niemal niemożliwa,

ale, na szczęście, tylko pozornie.

W polskim społeczeństwie istnieje zapotrzebowanie

na rzetelną i ciekawie zaprezentowaną informację naukową. Dość wspomnieć, że

czasopismo "Wiedza i życie", a także "Świat nauki" rozchodzą się w naprawdę

dużych nakładach, legendarna już telewizyjna "Sonda" miała jeden z najwyższych

współczynników oglądalności spośród wszystkich programów, a zainteresowanie

takimi imprezami masowymi, jak "Festiwal nauki" czy "Piknik naukowy", znacznie

przekracza prognozy organizatorów. Również dobre książki z serii

popularnonaukowych rozchodzą się we względnie wysokich nakładach. Co stanowi

motor napędowy tak dużego zapotrzebowania?

Po pierwsze: ciekawość. Można naszemu

społeczeństwu przypisać niski stopień kultury i wykształcenia, ale z drugiej

strony trzeba przyznać, że wykazuje ono silną motywację do zdobywania

informacji. Szczególną tradycją, kultywowaną przez wszystkie środowiska, jest

oglądanie wieczornych wiadomości telewizyjnych, co nie w każdym, nawet bardziej

od nas rozwiniętym kraju, jest tak powszechnym zwyczajem. Nasz Kowalski jest

ciekawy, co powiedzą o katastrofach, wojnach i rozgrywkach politycznych, ale

także chciałby jakoś wytłumaczyć sobie świat i zjawiska w nim zachodzące, a

jedną z dróg, przybliżających do tego celu, jest naukowa percepcja

rzeczywistości. To oczekiwanie warto wykorzystać. Po drugie: statystyczny

obywatel doskonale zdaje sobie sprawę z tego, że otaczająca go cywilizacja

zmienia się w coraz szybszym tempie, i że zmiany te wywodzą się wprost z

najnowszych osiągnięć nauki. Żeby orientować się, nie wypaść z obiegu, pozostać

konkurencyjnym wobec innych w miejscu pracy, a także w towarzystwie, musi mieć

"oczy i uszy otwarte". Po trzecie - wszyscy żywimy nadzieję na lepsze jutro, na

zwycięstwo nad chorobami, na dłuższe życie, na znalezienie rozwiązań

uniwersalnych. Być może, że właśnie odkryto życie na Marsie, albo wynaleziono

lekarstwo na raka, warto więc śledzić ostatnie doniesienia. Nasz Kowalski jest

świadomy, że takie lekarstwo może kiedyś przydać się także jemu.

Mając podatną glebę, należy zastanowić się nad

ulepszeniem lub intensyfikacją działań, a nade wszystko nad dostosowaniem ich do

specyfiki polskich warunków, zarówno społecznych, jak i gospodarczych. Aby

zaspokoić potrzeby i utrafić w gusta różnych adresatów, skuteczne

upowszechnianie nauki powinno odbywać się wielotorowo. Sposoby są znane, chodzi

tylko o odpowiednią organizację, a także o uwzględnienie lokalnych potrzeb i

uwarunkowań. Przypomnę szeroko praktykowane w świecie działania: wydawanie

książek i czasopism popularnonaukowych, audycje telewizyjne i radiowe, w tym

telewizja edukacyjna, prowadzenie działów naukowych w gazetach codziennych i

czasopismach, imprezy typu festiwalowego, otwarte wykłady i odczyty, uniwersytet

powszechny i kursy wszelkiego rodzaju, rozprowadzanie tematycznych kaset video i

płyt optycznych (CD-ROM-y), oraz naukowe serwisy informacyjne czasopism i

różnych instytucji czy organizacji w internecie. Nie roszcząc sobie pretensji do

całościowego omówienia, które znacznie przekraczałoby skromne ramy tej pracy,

chciałbym ustosunkować się do kilku wybranych zagadnień, związanych z

upowszechnianiem wiedzy w Polsce.

Tradycyjnym sposobem popularyzacji wiedzy i nauki

jest wydawanie książek o określonym profilu tematycznym, napisanych w ciekawy i

przystępny sposób. Niestety, książkowy rynek wydawniczy w Polsce uległ załamaniu

w 1989 roku i do dzisiejszego dnia nie powrócił do normalnego stanu. Przyczyny

tego załamania były różne, m.in. pauperyzacja społeczeństwa, zalew tłumaczeń

książek z zagranicy (niestety, przeważnie nie najwyższej jakości), a także brak

efektywnej dystrybucji, która do chwili obecnej nie funkcjonuje jak należy.

Niekorzystne tendencje zostały wzmocnione przez ogólnocywilizacyjne zjawisko

odwrotu od korzystania ze słowa drukowanego na korzyść różnych sposobów przekazu

audiowizualnego. Czyżby więc należało zaniechać wydawania książek i, uprzedzając

kulturowe trendy, zacząć inwestować wyłącznie w nośniki nowoczesnego pisma

obrazkowego? Uważam, że taka decyzja byłaby z pewnością przedwczesna, a

prawdopodobnie także generalnie chybiona. Przedwczesna dlatego, że książka wciąż

pełni niezwykle istotną rolę w upowszechnianiu kultury, zarówno całościowym, jak

i bardziej ukierunkowanym - wiedzy naukowej. Być może, że rola książki będzie

nadal malała, że powstaną tak sprawne, ogólnodostępne i przyjazne dla

użytkownika techniki przekazu audiowizualnego, że oddziaływanie słowa

drukowanego zostanie zmarginalizowane, zwłaszcza w dziedzinie nauk ścisłych. Ale

nie zostanie wyrugowane do końca i całkowicie z bardzo prostego powodu, a

mianowicie odmiennej percepcji neurofizjologicznej bodźców audiowizualnych wobec

tych związanych z czytaniem (nie oglądaniem!) pisma, złożonego ze znaków

nieobrazkowych. Obraz oglądany, np. wideoklip, dociera do mózgu "taki, jaki

jest", po prostu zostaje zarejestrowany. Nie musi być dalej przetwarzany i

analizowany, a czy wzbudzi jakiekolwiek skojarzenia lub refleksje, zależy

wyłącznie od przygotowania, wiedzy i wrażliwości osobniczej odbiorcy. Całkowicie

odmienna jest procedura odczytywania pisma literowego: określone fragmenty

mózgu, inne niż przy percepcji wizualnej, ulegają aktywacji w celu wykonania

pracy myślenia abstrakcyjnego. Litery same w sobie znaczą niewiele, natomiast

pojedyncze słowa to znaczeniowe moduły, a zdania i kontekst stanowią odmienne,

kolejne piętra procesu abstrakcyjnego kojarzenia. Są ludzie, którzy dobrze

odbierają słowo pisane, często nawet lepiej niż po przetłumaczeniu go na

komunikat obrazowy, najwidoczniej praca "abstrakcyjnej deszyfracji" w

semantycznym ośrodku mózgowym odpowiada im bardziej niż łatwiejsza, ale mniej

angażująca rejestracja obrazu. Być może wiąże się to z tym, że procesy:

szyfrowania, wykonywany przez autora, i odszyfrowania, będący udziałem

czytelnika, nigdy nie są całkowicie tożsame, w związku z tym czytanie jest

zawsze jakąś formą twórczości, wymagającej choćby minimalnego wykorzystania

wyobraźni. Kreatywna współpraca odbiorcy odgrywa niezwykle istotną rolę podczas

lektury utworów z dziedziny literatury pięknej, lecz jej udział jest nieodzowny

podczas zapoznawania się z każdym tekstem. Trudno określić, jaki wpływ na odbiór

tekstów niebeletrystycznych ma wyobraźnia czytelnika i na ile jej włączenie może

być czynnikiem inspirującym. Wydaje się więc, że dla ludzi, którzy wolą czytać

niż oglądać, zawsze będzie warto pisać i wydawać książki. Co nie oznacza, że

obraz nie może uzupełniać, a tam, gdzie to potrzebne, dookreślać słowa

drukowanego.

Zapotrzebowanie na dobrą i niedrogą książkę

istnieje, o czym świadczy powodzenie pozycji przecenionych i tłok wokół stoisk z

tanimi lub dawniejszymi wydaniami. A ponieważ drukowanie nakładów mniejszych niż

10 tysięcy nie spełnia celu, jakim jest upowszechnianie wiedzy, bo wtedy książka

dociera tylko do części księgarń w części kraju, ceny detaliczne muszą być

niskie. Jak ogólnie wiadomo, zbić ceny można przez podniesienie nakładu i

równoległą minimalizację kosztów produkcji, np. w wyniku zastosowania tańszego

papieru, poprzestaniu na skromniejszej szacie graficznej i, co jest swoistym

paradoksem, wydrukowaniu książki za granicą, gdzie można to zrobić taniej niż w

kraju (nawet uwzględniając koszty transportu). Wielkim wyzwaniem pozostaje

promocja książki, a więc jej odpowiednie reklamowanie. Koszty efektywnej

promocji zazwyczaj przekraczają możliwości wydawnictw popularnonaukowych.

Niewątpliwie fenomenem jest fakt, że czasopisma w

Polsce rozchodzą się w nakładach o rząd wielkości większych niż książki.

Niezależnie od przyczyn zjawiska, które są wielorakie i złożone, należy taką

sytuację wykorzystać, tym bardziej, że popularyzacja nauki w świecie drukowanych

mass-mediów staje się modna. Co prawda dziennikarzom, a także wielu czytelnikom,

zależy głównie na sensacjach naukowych, ale tym bardziej nie można zostawić

spraw tylko własnemu biegowi. Do upowszechniania wiedzy w niespecjalistycznych,

popularnych czasopismach powinni włączyć się popularyzatorzy, a także związani z

popularyzacją naukowcy. Wszystko wskazuje na to, że zapotrzebowanie na taką

działalność będzie rosło. Wydaje się, że brakuje ogniwa organizacyjnego, które

zapewniłoby efektywny kontakt autorów z żywiołowym rynkiem czasopism.

Telewizja publiczna robi dobre programy edukacyjne

dla dzieci i młodzieży, emitowane zwykle w porach niskiej oglądalności (wczesne

popołudnie). Zapewne te programy pomyślane są jako uzupełnienie edukacji

szkolnej i przeznaczone dla uczniów, którzy właśnie powrócili z zajęć do domu.

Natomiast niemal zupełnie brak audycji popularnonaukowych dla pozostałej,

pracującej części społeczeństwa, które mogą być oglądane późnym popołudniem i

wieczorem. Również wiadomości telewizyjne powinny zawierać, poza doniesieniami o

polityce, konfliktach zbrojnych i katastrofach, także informacje z frontu

naukowego, na temat zastosowań odkryć i wynalazków, jak również o zagadnieniach

związanych ze środowiskiem naturalnym i szeroko rozumianą biosferą. Warto w tym

miejscu podnieść po raz kolejny propozycję utworzenia osobnego telewizyjnego

kanału ogólnopolskiego, który emitowałby programy popularyzujące naukę, jak

naukowy serwis informacyjny, wykłady i dyskusje panelowe na "gorące" tematy,

filmy przyrodnicze, audycje o nauce polskiej, cykle edukacyjne w postaci kursów,

aktualne doniesienia o internetowych źródłach informacji, sprawozdania z

ciekawszych konferencji naukowych itd. Stacja może dodatkowo pełnić funkcję

popularnych na zachodzie "weather channels", czyli nadawać co godzinę prognozy

pogody, a także krótkie, 5-minutowe wiadomości ogólne. Dobrym zwyczajem byłoby

włączenie do programu "wideo-klipów" z muzyką klasyczną i interesujących audycji

z dziedziny sztuki, a także nauk humanistycznych. Ponieważ kanał byłby z

założenia publiczny, czyli bezpłatny, nie obyłoby się bez reklam, chociaż ich

profil raczej powinien obejmować np. samochody i komputery, a nie dezodoranty i

środki higieniczne "always". Przypuszczam, że do współpracy przy tworzeniu

takiej stacji można zaprosić prężną i dynamicznie rozwijającą się branżę

przemysłu turystycznego, którego audycje i płatne reklamy byłyby mile widziane w

programach. Taka stacja, jako instytucja wyższej użyteczności publicznej,

powinna być częściowo sponsorowana przez KBN i MEN. Powołanie osobnego kanału

popularyzującego naukę wynika po części także z niecelowości forsowania

programów naukowych w głównych programach ogólnopolskich. Należy raczej pójść

drogą specjalizacji i nie zmuszać entuzjastów seriali brazylijskich i

bebechowatych horrorów do oglądania dyskusji o wprowadzaniu upraw

transgenicznych, i oczywiście vice versa. Podobnie jest na rynku czasopism: kto

inny czyta "Wiedzę i Życie", a kto inny "Detektywa" lub "Twój Styl". Nie inaczej

w eterze: za granicą istnieją i doskonale prosperują takie stacje, jak "Discovery"

lun "Planete". Czy naprawdę nas na to nie stać?

W odróżnieniu od obecnie działających głównych

kanałów publicznej telewizji, które dla autorów i instytucji związanych z nauką

są w zasadzie hermetycznie zamknięte, duże i wciąż nie w pełni wykorzystane

możliwości popularyzowania nauki oferują rozgłośnie radiowe. Także i tutaj,

podobnie jak w przypadku czasopism popularnych, najczęściej brak wystarczająco

drożnego kanału informacyjnego między światem nauki a studiem radiowym.

Newralgicznym punktem są, jak zwykle, finanse: radio nie posiada środków na

honoraria.

Odmiennym, choć nie mniej ważnym sposobem

upowszechniania wiedzy mogą być kursy, prowadzone np. w ramach nowo utworzonego

Uniwersytetu Powszechnego. Idea nienowa, natomiast coraz bardziej aktualna w

dzisiejszych czasach rozwoju cywilizacyjnego, najszybszego w dziejach ludzkości.

Według prezentowanego tutaj projektu można wyobrazić sobie Uniwersytet jako

uczelnię dwustopniową. Stopień podstawowy obejmie kursy ogólne, w razie potrzeby

połączone z pokazami i wycieczkami w teren lub do odpowiednich instytucji.

Mówiąc najogólniej, celem tych kursów będzie pogłębianie i aktualizowanie wiedzy

w zakresie nauk ścisłych, humanistycznych i w dziedzinie sztuki, a także

objaśnianie zjawisk przyrodniczych i procesów technicznych. Uniwersytet

Powszechny może również objąć patronat nad szeregiem kursów doskonalących

umiejętności typu artystycznego, rzemieślniczego i "hobbystycznego". Przy tak

rozległym polu działania nie wszystkie zajęcia będą związane bezpośrednio z

nauką sensu stricte, chociaż z pewnością będzie można je traktować jako

sposób na poszerzenie wiedzy ogólnej. Jeśli chodzi o stopień zaawansowany, to

uruchomi się w jego ramach kursy bardziej specjalistyczne i na wyższym poziomie,

dające uprawnienia, np. przy przekwalifikowywaniu zawodowym. Po zaliczeniu

kursanci z obu stopni otrzymają odpowiednie certyfikaty. Wszystkie kursy będą

płatne, a czesne zostanie obliczone na możliwie jak najniższym poziomie na

podstawie rzeczywistych kosztów prowadzenia kursu, które mogą ulec obniżeniu w

przypadku otrzymania dotacji. Uczestnikiem kursów U.P. będzie mógł zostać każdy

obywatel, bez względu na wiek i wykształcenie. Zajęcia będą odbywać się w

dogodnych porach w wyższych uczelniach, szkołach, instytucjach naukowych i

biurach poza godzinami pracy i urzędowania. Wykładowcy będą otrzymywać

honoraria.

Kolejnym, ważnym sposobem upowszechniania nauki i

jej aplikacji są tzw. "dni otwartych drzwi" w różnych instytucjach badawczych i

zakładach przemysłowych. Np. we francuskich elektrowniach atomowych w określonym

dniu w tygodniu każdy może przyjść, aby zapoznać się z zakładem - wyznaczeni

pracownicy oprowadzają chętnych i udzielają wyjaśnień na temat rozwiązań

technicznych. Na marginesie: we Francji ok. 80% energii uzyskuje się w zakładach

nuklearnych, a społeczna akceptacja rozbudowy przemysłu jądrowego osiągnięta

została głównie na drodze szeroko zakrojonego programu

informacyjno-edukacyjnego. U nas organizuje się, głównie dla szkół, grupowe

zwiedzanie placówek badawczych, ale są to akcje jednorazowe i raczej

odosobnione, natomiast do zakładów przemysłowych osoby postronne zwykle nie są

wpuszczane. Przypuszczam, że można udostępnić w odpowiednim zakresie do

zwiedzania zarówno instytuty naukowe, jak i obiekty przemysłowe, i że jest to

tylko kwestia odpowiednich decyzji i dobrej organizacji. O Warszawskim Festiwalu

Nauki, który odbył się po raz pierwszy w 1997 roku, pisałem w innym miejscu

(Nauka, 1/98, 189). Ta ze wszech miar godna poparcia inicjatywa zaangażowała

podczas jednego wrześniowego weekendu 1997 r. ok. tysiąca pracowników nauki i

udostępniła ok. 40 placówek dla uczestników, których naliczono 20 tysięcy.

Uczestnictwo ludzi nauki w Festiwalu, w pełni dobrowolne i często pełne

entuzjazmu, może prowadzić do wyłonienia kadry przyszłego Uniwersytetu

Powszechnego, jak również całej plejady doskonałych popularyzatorów nauki. Z

drugiej strony, instytucje partycypujące w Festiwalu mogłyby prowadzić "dni

otwartych drzwi" nie tylko w czasie trwania tego zasłużonego przedsięwzięcia.

Warto więc pomyśleć o książkowym wydaniu festiwalowego katalogu ze

streszczeniami imprez oraz nazwiskami i adresami organizatorów, adresowanego

zarówno do zainteresowanych problemami nauki obywateli, jak i do redakcji

upowszechniających naukę, zarówno tych poszukujących tematów, jak i

popularyzatorów.

Inną interesującą formą upowszechniania nauki jest

tzw. turystyka naukowa. U nas raczej nieznana, za granicą powoli zdobywa sobie

coraz więcej zwolenników. Imprezy polegają na wakacyjnych wyjazdach, zwłaszcza

młodzieży, do miejscowości znanych z rozbudowanej bazy badawczej i

badawczo-przemysłowej, gdzie poziom prowadzonych prac jest wysoki, a w

laboratoriach spotkać można wybitne indywidualności ze świata nauki. Pobyt nie

ogranicza się wyłącznie do zwiedzania tych placówek, ale urozmaicony jest

wycieczkami do pobliskich zakładów przemysłowych, przyrodniczych parków

narodowych i unikatowych dzieł architektonicznych. Sądzę, że nasze biura podróży

mogą zainteresować się włączeniem takich imprez do swojej oferty, i to imprez

zarówno krajowych, jak i zagranicznych, pod warunkiem odpowiedniego wsparcia

merytorycznego i organizacyjnego ze strony świata nauki. Byłoby dobrze, gdyby na

częściowe dofinansowanie takich wyjazdów, a także podobnych imprez, np.

wakacyjnych stażów naukowych, dało się uruchomić jednorazowe dotacje dla

najzdolniejszych uczniów i studentów (np. granty przyznawane na indywidualne

wnioski z KBN, które można nazwać Junior).

Na koniec chciałbym krótko wspomnieć o

zagadnieniach, dotyczących krajowej kadry autorów publikacji popularyzujących

naukę, a także o merytorycznej ocenie tekstów. Mamy wielu doskonałych

popularyzatorów, których podzielę na aktywnych i potencjalnych. Ci potencjalni

pozostają nieaktywni z różnych powodów, a jedną z przyczyn takiego stanu rzeczy,

jak pisałem wyżej, jest brak wydajnego kanału informacyjnego między autorami a

mediami. Niektórzy naukowcy, którzy nie chcą inwestować czasu w pisanie artykułu

dla nieznanego i niepewnego wydawcy, a potem ubiegać się o opublikowanie pracy,

powinni wyraźnie odczuwać zapotrzebowanie, zarówno społeczne, jak i

instytucjonalne, i pisać na konkretne zlecenie. Stworzenie odpowiedniego klimatu

i warunków organizacyjnych, a także podniesienie prestiżu tego rodzaju pracy i

jej wymiernych efektów, nie tylko finansowych, ale także np. poprzez zwiększenie

uznawanego i punktowanego dorobku naukowego, z pewnością zaowocuje uaktywnieniem

wielu autorów, rekrutujących się spośród kadry naukowej i naukowo-dydaktycznej.

Co do poziomu artykułów, popularyzujących wiedzę,

to publikowane prace są naturalnie bardzo różne i trudno generalizować, bo

istnieją zarówno kiksy, jak i perły; często wielu świetnym merytorycznie tekstom

potrzebne są daleko idące poprawki redakcyjne, aby przesłanie było wystarczająco

czytelne, a lektura łatwa i przyjemna. Od czegóż są jednak redaktorzy? Inna

sprawa niepokoi mnie bardziej, a dotyczy ona "hitów" naukowych, jednodniowych

sensacji, na dodatek często tak dalece spłyconych, że nie mających wiele

wspólnego ze stanem faktycznym. Autorami takich "przebojów" są najczęściej nie

naukowcy, lecz tzw. dziennikarze naukowi, czyli zazwyczaj pracownicy redakcji,

akurat oddelegowani do działu czasopisma, zajmującego się nauką. Niedobrze

jednak się dzieje, gdy redakcje narzucają podobny styl autorom współpracującym,

rekrutującym się spośród ludzi nauki lub wytrawnych popularyzatorów. Cóż bowiem

innego wniesie kilkuzdaniowa rewelacja ponad syndrom "rozdziawionych ust", a

czytelnik najwyżej pokiwa głową i skwituje: "co też to się dzisiaj wyrabia".

Przecież nie chodzi o to, aby obywatel kojarzył naukowca z Frankensteinem i

obarczał go całą odpowiedzialnością za zło, które jakoby powstawało za jego

przyczyną. Przeciwnie, idzie nam o to, aby naukę nie tylko oswoić, ale i

przyswoić, choćby cząstkowo i po trochu. W tym kontekście najwyżej cenić trzeba

artykuły kompleksowe, naświetlające problemy z różnych stron i przedstawiające

tło, sytuujące poruszane zagadnienie w szerszym krajobrazie naukowym i

cywilizacyjnym. Nie da się tego wszystkiego dokonać w krótkim doniesieniu, ale

warto chociaż skrótowo umiejscowić problem w świecie nauki, a także zdefiniować

trudniejsze terminy i pojęcia. Jeśli artykuł, obojętnie - krótki czy długi,

pozwoli Kowalskiemu trochę lepiej zrozumieć świat, a także po lekturze

pozostanie mu w pamięci pożyteczna informacja, nawet jedna i skromna, to cel

publikacji takiego tekstu zostanie spełniony.

W powyższym krótkim omówieniu starałem się

zasygnalizować niektóre problemy, związane z upowszechnianiem nauki w naszym

kraju i z organizacją tego niezwykle ważnego przedsięwzięcia. Do tych i innych

zagadnień należy powracać jeszcze nie raz, aby kontynuować "organiczną" pracę u

podstaw, od której, w odpowiednio rozległej perspektywie, zależeć będzie rodzaj

naszego narodowego bytu, pozycja kraju w światowym rankingu, a także, w

całkowicie uchwytnym stopniu, jakość i poziom życia naszych obywateli.

|

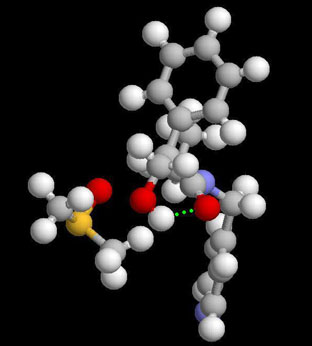

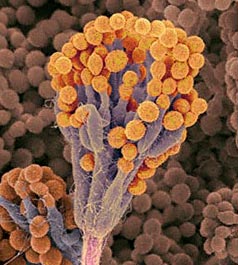

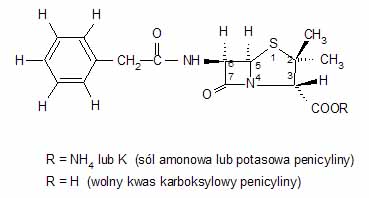

Poniżej zamieszczono Spis treści, Wstęp, Wprowadzenie oraz fragmenty wybranych artykułów. Tom zawiera przekrojowe

informacje o inżynierii genetycznej, a więc o sposobach manipulacji genami,

implikacjach praktycznych zarówno w rolnictwie, jak i w medycynie, poruszane

są aspekty ewolucyjne, etyczne, teologiczne i filozoficzne, przedstawiona

została interpretacja zjawiska w literaturze i filmie, ukazano wymiar prawny

oraz oficjalne stanowiska różnych gremiów. Unikano arbitralnych ocen,

bo na podstawie tak szerokiego spektrum informacji

czytelnik powinien wyrobić sobie własną opinię o zagadnieniu.

Poniżej zamieszczono Spis treści, Wstęp, Wprowadzenie oraz fragmenty wybranych artykułów. Tom zawiera przekrojowe

informacje o inżynierii genetycznej, a więc o sposobach manipulacji genami,

implikacjach praktycznych zarówno w rolnictwie, jak i w medycynie, poruszane

są aspekty ewolucyjne, etyczne, teologiczne i filozoficzne, przedstawiona

została interpretacja zjawiska w literaturze i filmie, ukazano wymiar prawny

oraz oficjalne stanowiska różnych gremiów. Unikano arbitralnych ocen,

bo na podstawie tak szerokiego spektrum informacji

czytelnik powinien wyrobić sobie własną opinię o zagadnieniu.